NVIDIA TAO Toolkit

یک چارچوب هوش مصنوعی با کد پایین برای تسریع توسعه مدل هوش مصنوعی بینایی مناسب برای تمام سطوح مهارت، از مبتدیان تازه کار گرفته تا...

یک چارچوب هوش مصنوعی با کد پایین برای تسریع توسعه مدل هوش مصنوعی بینایی مناسب برای تمام سطوح مهارت، از مبتدیان تازه کار گرفته تا دانشمندان داده خبره، فراهم می کند. با NVIDIA TAO (Train, Adapt, Optimize) Toolkit، توسعهدهندگان میتوانند از قدرت و کارایی یادگیری انتقال برای دستیابی به دقت پیشرفته و توان تولید در زمان رکورد با سازگاری و بهینهسازی استفاده کنند.

در NVIDIA GTC 2023 ،NVIDIA NVIDIA TAO Toolkit 5.0 را معرفی کرد که ویژگی های پیشگامانه ای را برای بهبود هر مدل AI به ارمغان می آورد. ویژگی های جدید شامل معماری منبع باز، مدل های از پیش آموزش دیده مبتنی بر ترانسفورماتور، حاشیه نویسی داده به کمک هوش مصنوعی و قابلیت استقرار مدل ها بر روی هر پلتفرمی است.

مدلهای NVIDIA TAO را در هر پلتفرمی و در هر مکانی استقرار دهید

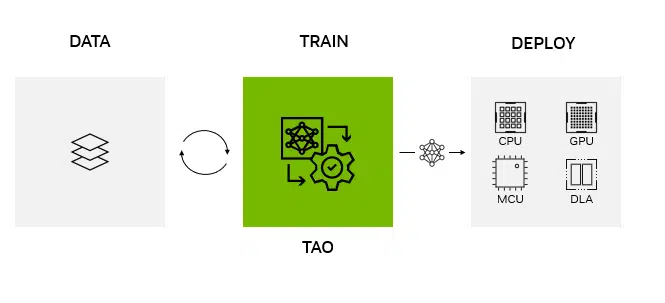

NVIDIA TAO Toolkit 5.0 از استخراج مدل در ONNX پشتیبانی می کند. این امر امکان استقرار یک مدل آموزشدیده با NVIDIA TAO Toolkit را بر روی هر پلتفرم محاسباتی (GPU، CPU، MCU، DLA، FPGA) در لبه یا در فضای ابری ممکن میسازد. NVIDIA TAO Toolkit فرآیند آموزش مدل را ساده می کند و مدل را برای خروجی استنتاج بهینه می کند و هوش مصنوعی را در صدها میلیارد دستگاه نیرو می دهد.

یک رهبر جهانی در میکروکنترلرهای تعبیه شده، NVIDIA TAO Toolkit را در گردش کار توسعه دهندگان STM32Cube AI خود ادغام کرد. این آخرین قابلیتهای هوش مصنوعی را در اختیار میلیونها توسعهدهنده STMicroelectronics قرار میدهد. این برای اولین بار توانایی ادغام هوش مصنوعی پیشرفته را در موارد استفاده گسترده اینترنت اشیاء و استفاده از لبه با پشتیبانی از STM32Cube فراهم می کند. اکنون با NVIDIA TAO Toolkit، حتی مبتدیترین توسعهدهندگان هوش مصنوعی میتوانند مدلهای هوش مصنوعی را برای اجرا بر روی STM32 MCU در محدوده بودجه محاسباتی و حافظه میکروکنترلر بهینهسازی و کمی سازی کنند. توسعه دهندگان همچنین می توانند مدل های خود را بیاورند و با استفاده از TAO Toolkit آن را تنظیم کنند.

اطلاعات بیشتر در مورد این کار در نسخه ی نمایشی زیر از STMicroelectronics گرفته شده است.

حاشیه نویسی و مدیریت داده به کمک هوش مصنوعی

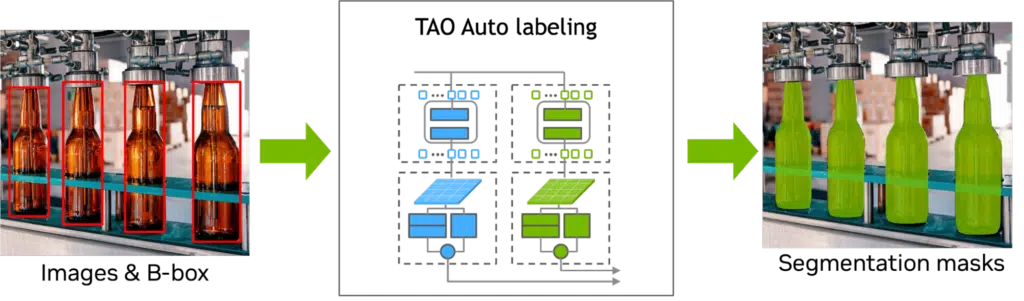

حاشیه نویسی داده ها همچنان یک فرآیند گران و زمان بر برای تمام پروژه های هوش مصنوعی است. این امر به ویژه برای کارهای CV مانند تقسیم بندی که نیاز به تولید یک ماسک تقسیم بندی در سطح پیکسل در اطراف شی دارند، صادق است. به طور کلی، ماسک های تقسیم بندی 10 برابر بیشتر از تشخیص یا طبقه بندی اشیا هزینه دارند.

حاشیه نویسی ماسک های تقسیم بندی با قابلیت های جدید حاشیه نویسی به کمک هوش مصنوعی با استفاده از TAO Toolkit 5.0 سریع تر و کم هزینه تر است. اکنون میتوانید از معماری تقسیمبندی با نظارت ضعیف، Mask Auto Labeler (MAL) برای کمک به حاشیهنویسی تقسیم بندی و در فیکس کردن و قرار دادن جعبههای مرزی برای تشخیص اشیا استفاده کنید. جعبههای مرزی شل در اطراف یک شی در دادههای حقیقت زمینی میتواند منجر به نتایج تشخیص نامطلوب شود، اما با حاشیهنویسی به کمک هوش مصنوعی، میتوانید جعبههای محدود خود را بر روی اشیاء قرار دهید و به مدلهای دقیقتر برسید.

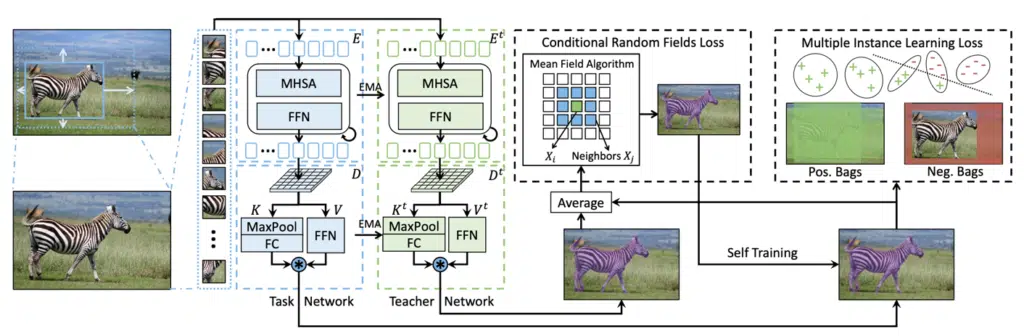

MAL یک چارچوب برچسبگذاری خودکار مبتنی بر ترانسفورماتور است که بهعنوان مثال، تنها با استفاده از حاشیهنویسی جعبه، تقسیمبندی میشود. MAL تصاویر برش داده شده در جعبه را به عنوان ورودی می گیرد و به صورت مشروط برچسب های شبه ماسک را تولید می کند. از فرمت حاشیه نویسی COCO برای برچسب های ورودی و خروجی استفاده می کند.

MAL به طور قابل توجهی شکاف بین برچسب گذاری خودکار و حاشیه نویسی انسانی را برای کیفیت ماسک کاهش می دهد. نمونههای تقسیمبندی نمونهای که با استفاده از ماسکهای تولید شده توسط MAL آموزش داده شدهاند، میتوانند تقریباً با عملکرد همتایان کاملاً نظارت شده مطابقت داشته باشند و تا ۹۷.۴ درصد عملکرد مدلهای کاملاً نظارت شده را حفظ کنند.

هنگام آموزش شبکه MAL، یک شبکه وظیفه و یک شبکه معلم (که ساختار ترانسفورماتور یکسانی دارند) با هم کار می کنند تا به خودآموزی کلاسی-آگنوستیک دست یابند. این امکان پالایش ماسکهای پیشبینی را با از دست دادن میدان تصادفی شرطی (CRF) و از دست دادن یادگیری چند نمونهای (MIL) فراهم میکند.

TAO Toolkit از MAL در خط لوله برچسبگذاری خودکار و خط لوله افزایش داده استفاده میکند. به طور خاص، کاربران میتوانند ماسکهای کاذب را روی تصاویر تقویتشده فضایی (مثلاً برش داده شده یا چرخانده) ایجاد کنند و با استفاده از ماسکهای تولید شده، جعبههای محدود مربوطه را اصلاح و سفت کنند.

ترانسفورماتورهای بینایی پیشرفته

ترانسفورماتورها عمدتاً به دلیل توجه به خود به معماری استاندارد در NLP تبدیل شده اند. آنها همچنین برای طیف وسیعی از وظایف هوش مصنوعی بینایی محبوبیت پیدا کرده اند. به طور کلی، مدلهای مبتنی بر ترانسفورماتور به دلیل استحکام، تعمیمپذیری و توانایی انجام پردازش موازی ورودیهای مقیاس بزرگ، میتوانند از مدلهای مبتنی بر CNN سنتی بهتر عمل کنند. همه اینها کارایی آموزش را افزایش میدهد، استحکام بهتری در برابر خرابی و نویز تصویر ارائه میکند و بر روی اشیاء نادیده تعمیم بهتری دارد.

TAO Toolkit 5.0 دارای چندین ترانسفورماتور بینایی پیشرفته (SOTA) برای کارهای محبوب CV است که در زیر توضیح داده شده است.

شبکه کاملاً توجه (Fully Attentional Network)

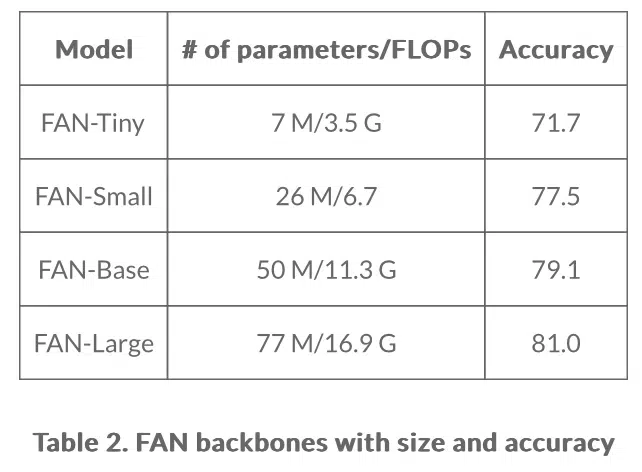

شبکه کاملاً توجه (FAN) یک خانواده ستون فقرات مبتنی بر ترانسفورماتور از تحقیقات NVIDIA است که به SOTA در استحکام در برابر فسادهای مختلف دست می یابد. این خانواده از ستون فقرات میتوانند به راحتی به دامنههای جدید تعمیم داده شوند و در برابر نویز، تاری و موارد دیگر قویتر باشند. یک طراحی کلیدی در پشت بلوک FAN، ماژول پردازش کانال توجه است که منجر به یادگیری بازنمایی قوی می شود. FAN را می توان برای کارهای طبقه بندی تصویر و همچنین کارهای پایین دستی مانند تشخیص اشیا و تقسیم بندی استفاده کرد.

همانطور که در جدول 2 نشان داده شده است، خانواده FAN از چهار ستون فقرات پشتیبانی می کند.

تبدیل کننده چشم انداز زمینه جهانی

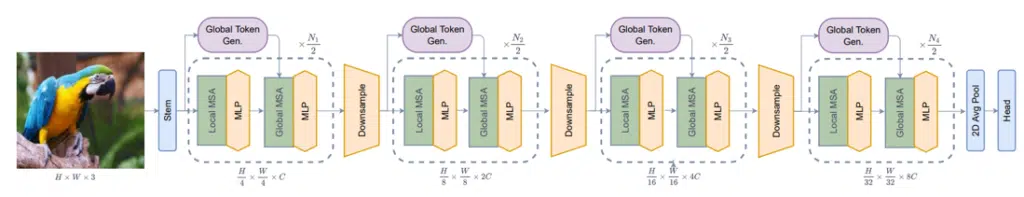

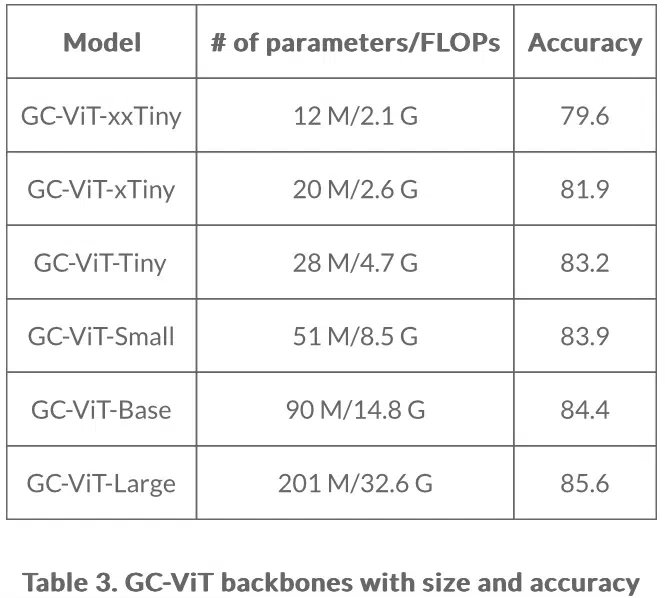

Global Context Vision Transformer (GC-ViT) یک معماری جدید از NVIDIA Research است که به دقت و کارایی محاسباتی بسیار بالایی دست می یابد. GC-ViT عدم تعصب القایی در ترانسفورماتورهای بینایی را برطرف می کند. با استفاده از توجه محلی به نتایج بهتری در ImageNet با تعداد پارامترهای کمتری می رسد.

خود توجهی محلی همراه با خود توجهی به زمینه جهانی می تواند به طور موثر و کارآمدی تعاملات فضایی بلند و کوتاه برد را مدل کند. شکل 6 معماری مدل GC-ViT را نشان می دهد. برای جزئیات بیشتر، Global Context Vision Transformers را ببینید.

همانطور که در جدول 3 نشان داده شده است، خانواده GC-ViT شامل شش ستون فقرات است که از GC-ViT-xxTiny (کارآمد محاسبه) تا GC-ViT-Large (بسیار دقیق) را شامل می شود. مدلهای GC-ViT-Large میتوانند به دقت بالای 1 85.6 در مجموعه داده ImageNet-1K برای وظایف طبقهبندی تصویر دست یابند. این معماری همچنین می تواند به عنوان ستون فقرات برای سایر وظایف CV مانند تشخیص شی و تقسیم بندی معنایی و نمونه استفاده شود.

دینو (DINO)

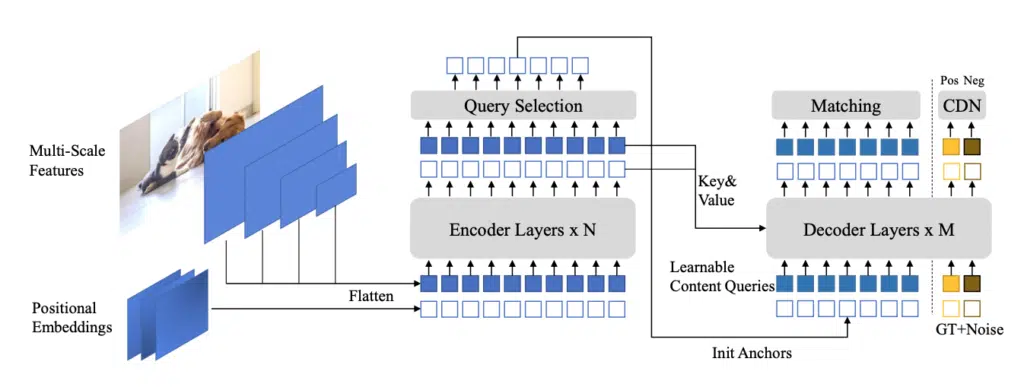

DINO (ترانسفورماتور تشخیص با لنگر حذف نویز بهبودیافته) جدیدترین نسل از ترانسفورماتورهای تشخیص (DETR) است. زمان همگرایی آموزشی سریع تری نسبت به نسخه قبلی خود به دست می آورد. تغییر شکلپذیر DETR (D-DETR) به حداقل 50 دوره برای همگرایی نیاز دارد، در حالی که DINO میتواند در 12 دوره در مجموعه داده COCO همگرا شود. همچنین در مقایسه با D-DETR به دقت بالاتری دست می یابد.

DINO از طریق استفاده از حذف نویز در طول آموزش به همگرایی سریعتری دست مییابد که به فرآیند تطبیق دوبخشی در مرحله تولید پروپوزال کمک میکند. همگرایی آموزشی مدلهای شبه DETR به دلیل ناپایداری تطابق دوبخشی کند است. تطبیق دو بخشی نیاز به عملیات NMS دست ساز و محاسباتی سنگین را از بین برد. با این حال، اغلب به آموزش بسیار بیشتری نیاز داشت زیرا حقایق زمینی نادرست با پیشبینیها در طول تطبیق دوبخشی مطابقت داشت. برای رفع چنین مشکلی، DINO جعبههای حقیقت پایه مثبت نویز و جعبههای حقیقت پایه منفی را برای رسیدگی به سناریوهای «بدون شی» معرفی کرد. در نتیجه، آموزش برای DINO خیلی سریع همگرا می شود. برای اطلاعات بیشتر، به DINO: DETR با جعبههای لنگر حذف نویز بهبودیافته برای تشخیص اجسام انتها به انتها مراجعه کنید.

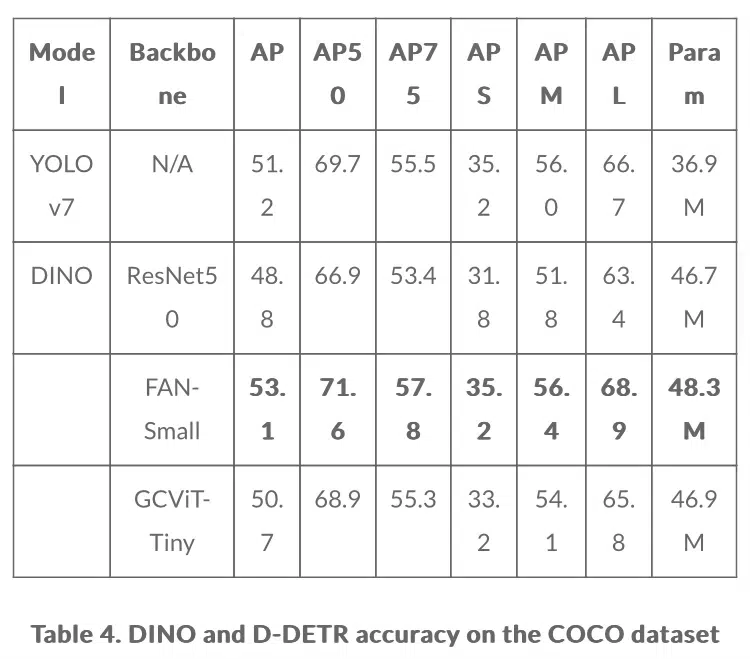

DINO در TAO Toolkit انعطافپذیر است و میتواند با ستونهای مختلف CNNهای سنتی مانند ResNets و ستونهای مبتنی بر ترانسفورماتور مانند FAN و GC-ViT ترکیب شود. جدول 4 دقت مجموعه داده COCO را در نسخه های مختلف DINO با YOLOv7 محبوب نشان می دهد. برای جزئیات بیشتر، به YOLOv7 رجوع کنید: کیسههای رایگان آموزشپذیر، پیشرفتهترین را برای آشکارسازهای شی در زمان واقعی تنظیم میکند.

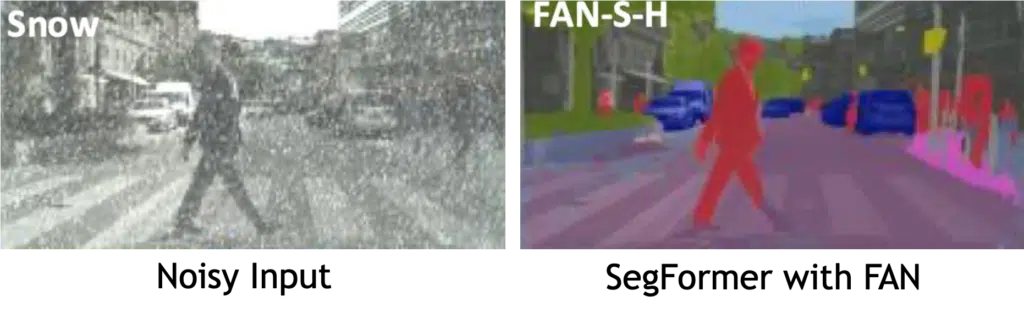

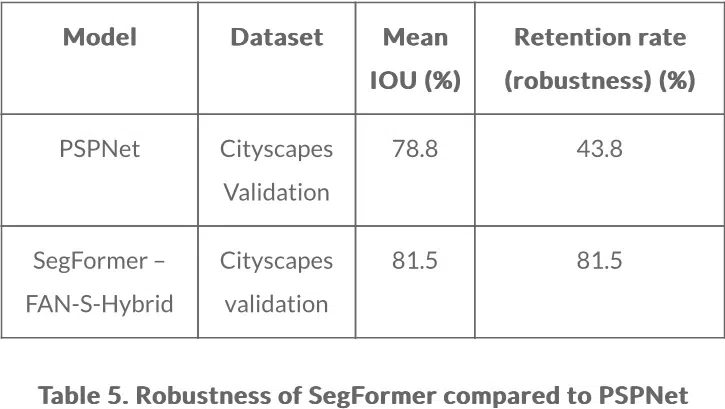

SegFormer

SegFormer یک تقسیم بندی معنایی مبتنی بر ترانسفورماتور سبک وزن است. رمزگشا از لایه های سبک وزن MLP ساخته شده است. از استفاده از رمزگذاری موقعیتی (بیشتر توسط ترانسفورماتورها استفاده می شود) اجتناب می کند، که استنتاج را در وضوح های مختلف کارآمد می کند.

افزودن ستون فقرات FAN به رمزگشای SegFormer MLP منجر به یک مدل تقسیم بندی معنایی بسیار قوی و کارآمد می شود. ترکیبی پایه FAN + SegFormer معماری برنده در چالش Robust Vision 2022 برای تقسیم بندی معنایی بود.

وظایف CV فراتر از تشخیص و تقسیم بندی شی

NVIDIA TAO Toolkit طیف وسیعی از وظایف CV را فراتر از تشخیص و تقسیم بندی سنتی اشیاء سرعت می بخشد. مدلهای جدید تشخیص و تشخیص کاراکتر در TAO Toolkit 5.0 توسعه دهندگان را قادر میسازد تا متن را از تصاویر و اسناد استخراج کنند. این تبدیل سند را خودکار می کند و موارد استفاده را در صنایعی مانند بیمه و امور مالی تسریع می کند.

تشخیص ناهنجاری ها در تصاویر زمانی مفید است که شی طبقه بندی شده بسیار متفاوت است، به طوری که آموزش با تمام تغییرات غیرممکن است. مثلاً در بازرسی صنعتی، عیب می تواند به هر شکلی باشد. استفاده از یک طبقهبندیکننده ساده میتواند منجر به بسیاری از نقصهای از دست رفته شود، اگر نقص قبلاً توسط دادههای آموزشی دیده نشده باشد.

برای چنین موارد استفاده، مقایسه جسم آزمایشی به طور مستقیم با یک مرجع طلایی می تواند منجر به دقت بهتر شود. TAO Toolkit 5.0 دارای یک شبکه عصبی سیامی است که در آن مدل تفاوت بین شی مورد آزمایش و یک مرجع طلایی را محاسبه می کند تا اگر شیء معیوب است طبقه بندی کند.

آموزش خودکار با استفاده از AutoML برای بهینه سازی هایپرپارامتر

یادگیری ماشین خودکار (autoML) کار دستی یافتن بهترین مدلها و فراپارامترها برای KPI مورد نظر در یک مجموعه داده را خودکار میکند. این می تواند به صورت الگوریتمی بهترین مدل را استخراج کند و بسیاری از پیچیدگی های ایجاد و بهینه سازی مدل هوش مصنوعی را از بین ببرد.

AutoML در TAO Toolkit برای بهینه سازی خودکار فراپارامترهای یک مدل کاملاً قابل تنظیم است. هم به متخصصان هوش مصنوعی و هم غیرمتخصصان پاسخ می دهد. برای افراد غیرمتخصص، نوت بوک هدایت شده Jupyter راهی ساده و کارآمد برای ایجاد یک مدل دقیق هوش مصنوعی ارائه می دهد.

برای کارشناسان، TAO Toolkit به شما کنترل کاملی می دهد که کدام هایپرپارامترها را تنظیم کنید و از کدام الگوریتم برای جاروها استفاده کنید. TAO Toolkit در حال حاضر از دو الگوریتم بهینه سازی پشتیبانی می کند: بهینه سازی Bayesian و Hyperband. این الگوریتمها میتوانند طیف وسیعی از فراپارامترها را برای یافتن بهترین ترکیب برای یک مجموعه داده معین جستجو کنند.

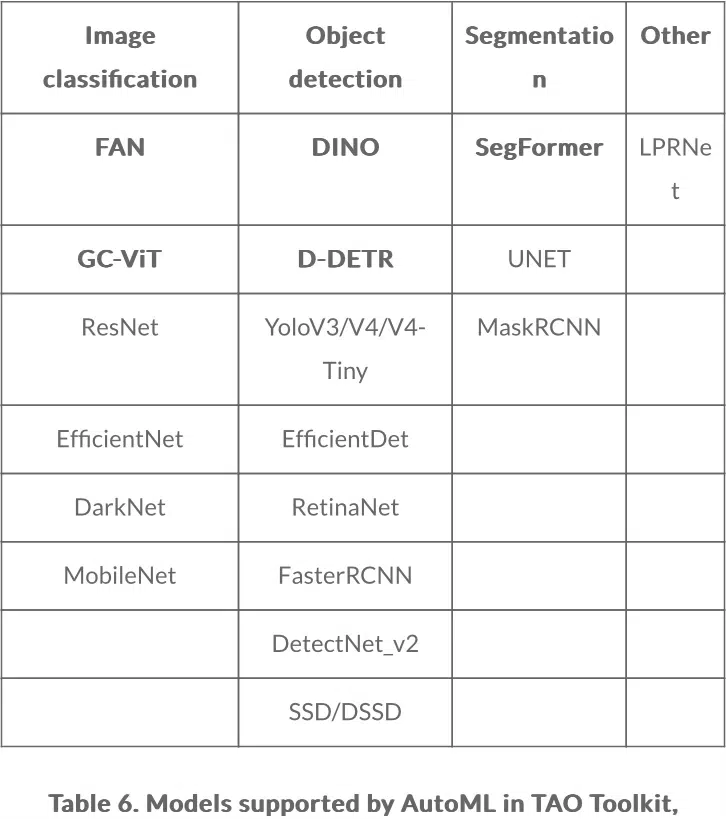

AutoML برای طیف گسترده ای از وظایف CV، از جمله چندین ترانسفورماتور بینایی جدید مانند DINO ،D-DETR ،SegFormer و غیره پشتیبانی می شود. جدول 6 فهرست کامل شبکه های پشتیبانی شده را نشان می دهد (موارد پررنگ در TAO Toolkit 5.0 جدید هستند).

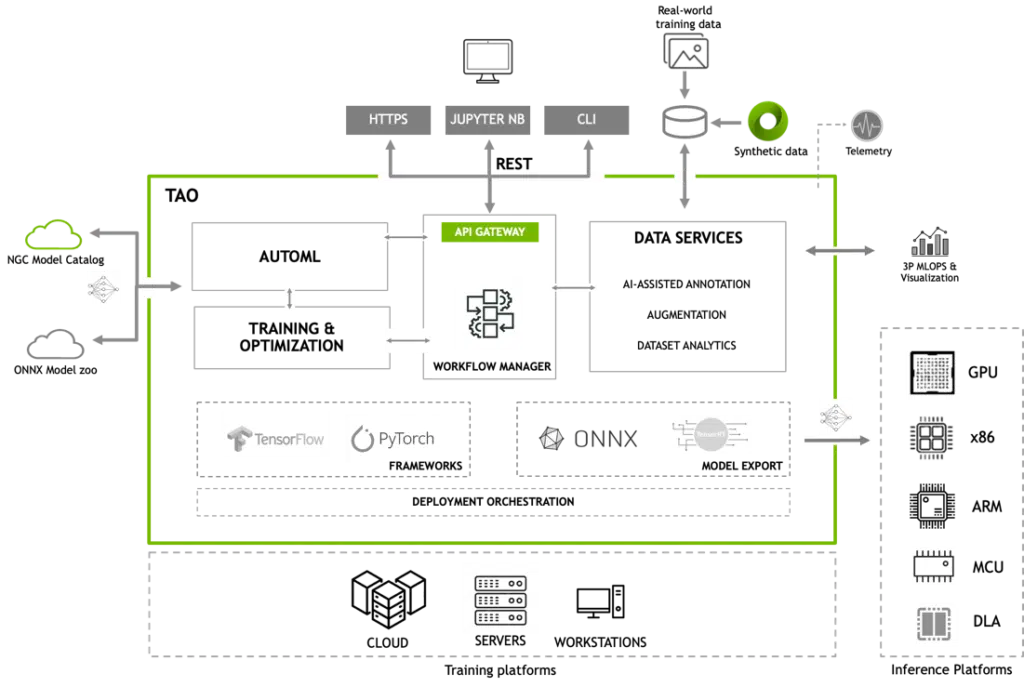

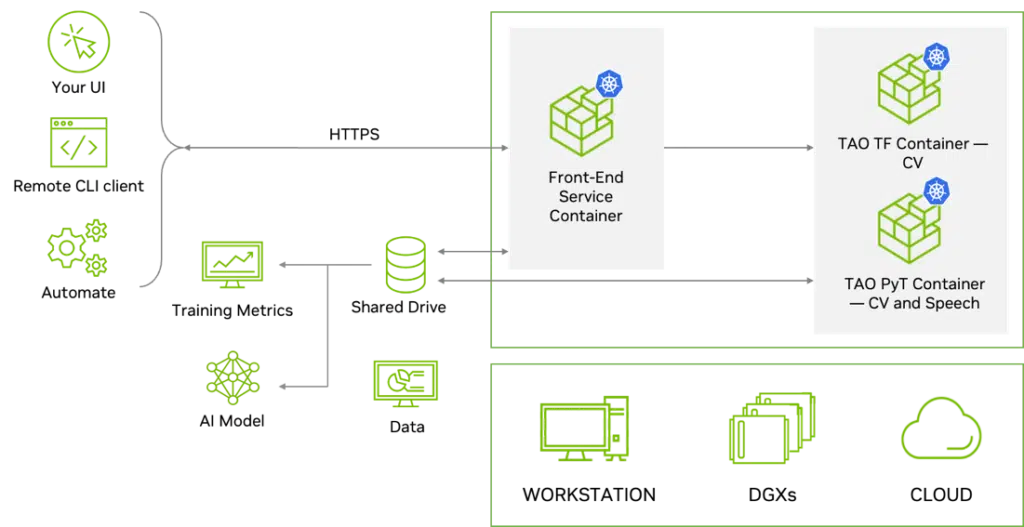

API های REST برای یکپارچه سازی گردش کار

TAO Toolkit ماژولار و بومی ابری است، به این معنی که به صورت کانتینر در دسترس است و با استفاده از Kubernetes قابل استقرار و مدیریت است. TAO Toolkit را می توان به عنوان یک سرویس خود مدیریت بر روی هر ابر عمومی یا خصوصی، DGX یا ایستگاه های کاری مستقر کرد. TAO Toolkit API های REST به خوبی تعریف شده را ارائه می دهد و ادغام آن را در گردش کار توسعه شما آسان می کند. توسعه دهندگان می توانند برای تمام کارهای آموزشی و بهینه سازی، نقاط پایانی API را فراخوانی کنند. این نقاط پایانی API را می توان از هر برنامه کاربردی یا رابط کاربری فراخوانی کرد، که می تواند کارهای آموزشی را از راه دور فعال کند.

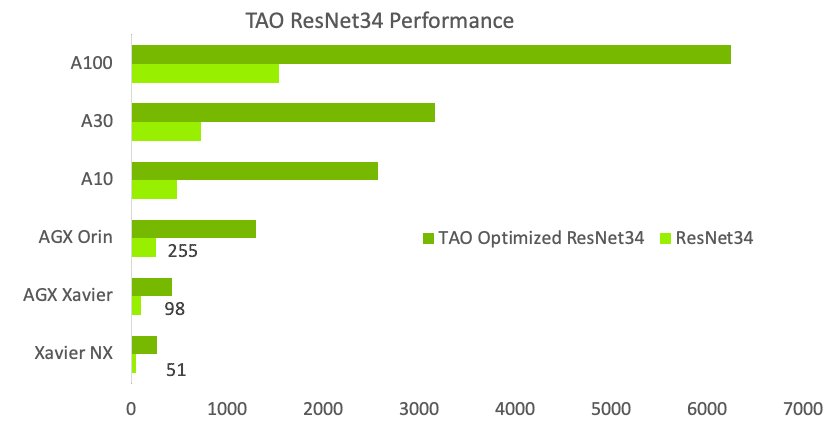

بهینه سازی استنتاج بهتر

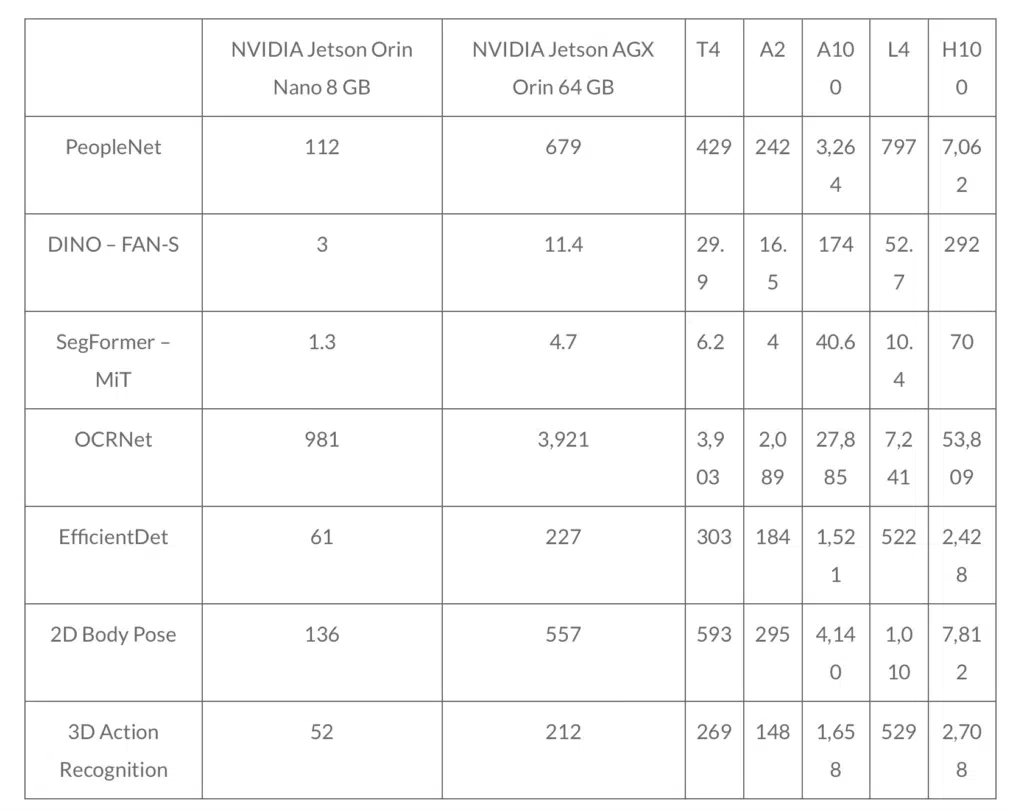

برای ساده سازی تولید و افزایش توان استنتاج، TAO Toolkit چندین تکنیک بهینه سازی عملکرد را ارائه می دهد. اینها شامل هرس مدل، کوانتیزاسیون با دقت کمتر و بهینهسازی TensorRT میشود که میتواند در مقایسه با یک مدل قابل مقایسه از باغوحشهای مدل عمومی، عملکرد 4 برابری تا 8 برابری را افزایش دهد.

باز و انعطاف پذیر، با پشتیبانی بهتر

یک مدل هوش مصنوعی خروجی را بر اساس الگوریتم های پیچیده پیش بینی می کند. این امر میتواند درک اینکه سیستم چگونه به تصمیم خود رسیده و اشکالزدایی، تشخیص و رفع خطاها را به چالش میکشد. هوش مصنوعی قابل توضیح (XAI) با ارائه بینشی در مورد چگونگی رسیدن مدلهای هوش مصنوعی به تصمیمات خود، به این چالشها رسیدگی میکند. این به انسان کمک می کند استدلال پشت خروجی هوش مصنوعی را درک کند و تشخیص و رفع خطاها را آسان تر می کند. این شفافیت می تواند به ایجاد اعتماد در سیستم های هوش مصنوعی کمک کند.

برای کمک به شفافیت و توضیح پذیری، TAO Toolkit اکنون به عنوان منبع باز در دسترس خواهد بود. توسعهدهندگان میتوانند نقشههای ویژگی را از لایههای داخلی و همچنین نقشههای حرارتی فعالسازی را برای درک بهتر استدلال پشت پیشبینیهای هوش مصنوعی مشاهده کنند. علاوه بر این، دسترسی به کد منبع به توسعه دهندگان انعطاف پذیری برای ایجاد هوش مصنوعی سفارشی، بهبود قابلیت اشکال زدایی و افزایش اعتماد به مدل های خود می دهد.

NVIDIA TAO Toolkit برای سازمانی آماده است و از طریق NVIDIA AI Enterprise (NVAIE) در دسترس است. NVAIE به شرکتها پشتیبانی حیاتی تجاری، دسترسی به کارشناسان هوش مصنوعی NVIDIA و اصلاحات امنیتی اولویتدار ارائه میدهد. برای دریافت پشتیبانی از کارشناسان هوش مصنوعی به NVAIE بپیوندید.

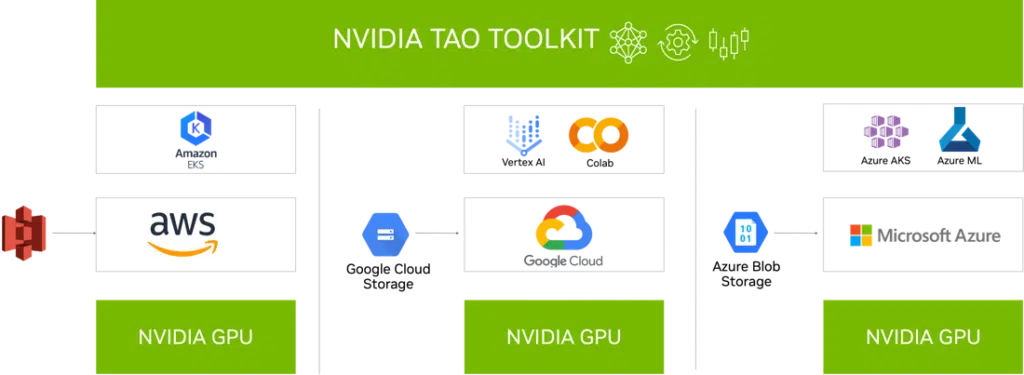

ادغام با خدمات ابری

NVIDIA TAO Toolkit 5.0 در سرویسهای هوش مصنوعی مختلفی که ممکن است قبلاً از آنها استفاده کنید، مانند Google Vertex AI، AzureML، سرویس Azure Kubernetes و Amazon EKS ادغام شده است.

خلاصه

TAO Toolkit پلتفرمی را برای هر توسعهدهنده، در هر سرویس و هر دستگاهی ارائه میکند تا به راحتی مدلهای سفارشی خود را منتقل کند، یاد بگیرد، کمیسازی و هرس را انجام دهد، گردشهای کاری پیچیده آموزشی را مدیریت کند، و حاشیهنویسی به کمک هوش مصنوعی را بدون نیاز به کدنویسی انجام دهد. در GTC 2023، NVIDIA در حال معرفی TAO Toolkit 5.0 است. ثبت نام کنید تا از آخرین به روز رسانی های TAO Toolkit مطلع شوید.